Ieri c’è stato qui a Udine, tra gli appuntamenti elettorali, questo bel convegno su tematiche economiche, o meglio di sostenibilità economica per il futuro della città.

Ottimi relatori han saputo dipingere il passato e il presente di Udine, raccontando le scelte territoriali fatte nel tempo nella logistica e nella manifattura, indicando come dal modello “emporiale” ci si stia ora spostando verso una città decisamente orientata al terziario avanzato, all’economia della conoscenza guidata dall’Università e dalle mille realtà imprenditoriali – leggi KIBS Knowledge Intensive Business Service, la loro eccellenza e la loro capacità di fare rete – che lavorano con il digitale e le nuove tecnologie, e al contempo analizzando i flussi economici e la propensione al consumo di una popolazione cittadina dove ormai un quarto degli abitanti ha più di sessantacinque anni..

Ci sono delle parole chiave: attrattività, ecosistema, comunità.

L’attrattività va innanzitutto riferita alla propensione di questo territorio a chiamare a sé “cervelli”, persone altamente qualificate dal punto di vista professionale, invertendo le dinamiche migratorie che vedono anche e di nuovo Udine e il Friuli come allevamenti da esportazione, giovani e meno giovani che ogni anno lasciano tutto e vanno altrove, spesso all’estero, in quanto molto meglio remunerati e accolti.

Perché parlo di accoglienza? Perché quelli che vengono qui alla periferia dell’impero (e che si vorrebbe giustamente far diventare cuore dell’Europa, multiculturale, innovativo in quanto capace di abitare la frontiera di una nuova concezione socioeconomica consapevole delle transizioni ecologiche e digitali del XXI secolo) dovrebbero anche rimanerci, trovare una bella casa e dei servizi territoriali di alta qualità, mettere magari su famiglia. E questo lo si ottiene appunto costruendo pazientemente ma consistentemente la qualità dell’Abitare che il territorio può offrire, nei suoi paesaggi naturali e soprattutto antropici, facendo emergere una partecipazione sociale alla vita della collettività e quindi un sentimento di appartenenza ai Luoghi.

Se un dirigente di una azienda si trasferisce a Udine e dintorni, non è tanto lo stipendio da 100k e il macchinone aziendale che lo trattiene qui, ma è la bellezza e il sentirsi a proprio agio, accolto in una comunità.

Il ragionamento vale anche se parliamo di attrattività turistica, ovvero vanno capovolte alcune affermazioni che ho sentito ieri, ovvero che andrebbero realizzate delle narrazioni territoriali capaci di chiamare qui persone per promuovere il territorio.

È tutto il contrario, e lo dico avendo progettato simili iniziative: l’obiettivo della progettazione territoriale e le azioni da compiere deve riguardare quella promozione culturale e sociale capace di rendere ricco di storie e “caldo” e desiderabile il Friuli e la sua identità in quanto brand, su cui poi costruire delle linee di progettazione anche turistica in grado di instaurare nel tempo una certa reputazione e di scandire con adeguati storytelling la ragione per cui visitare queste terra può essere meraviglia – schivando anche in tal modo sciocche propensioni a un turismo mordi-e-fuggi, a favore di esperienze lente di sapori e stili di vita, di relazioni autentiche, di “comodità psicologica” per il viaggiatore (non più “turista”) che si avventura nei patrimoni Unesco o nelle cittadine medievali o rurali o nella wilderness della Carnia.

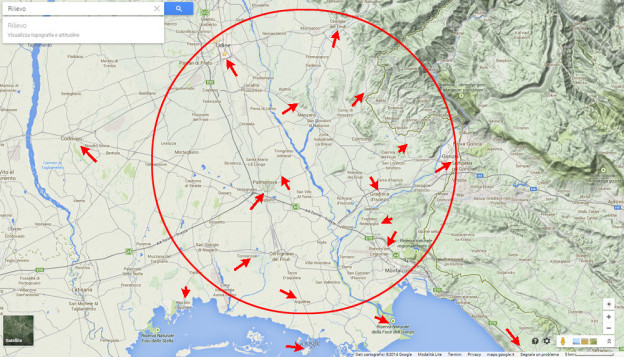

Il termine ecosistema non può che riferirsi alla capacità di visione, alla concettualizzazione che abbiamo ora, per progettare il futuro di Udine. Non mi interessa tanto Udine “capitale del Friuli”, e nemmeno “caput”, è un modello gerarchico di organizzazione dei territori che credo destinato a essere superato, a giudicare dai comportamenti delle collettività. Il territorio va pensato “a rete”, policentrico, dove i nodi della rete sono strettamente connessi – servizi, logistica, digitale – e il valore sta nelle relazioni, nella percezione ampia di un Noi orientato al futuro caratterizzato dai nostri storici valori di industriosità e innovazione, quella solita triade di “saper-fare, fare, far-sapere” dove allestire e comunicare lo stile peculiare del nostro abitare il mondo in quanto friulani.

Udine – se proprio vogliamo paradossalmente trovare un centro in una rete – dovrebbe piuttosto essere un hub, il mozzo della ruota che dà senso alla ruota stessa per muoversi su territori più lontani, non spazio vuoto ma pieno di know-how avanzato per la gestione organizzativa complessa di tutte le realtà manifatturiere e amministrative, per l’innovazione nei processi lavorativi, per ascoltare e metabolizzare a vantaggio dell’intero corpo sociale lo sviluppo di soluzioni iperlocali emergenti da promuovere sull’intero territorio, per costruire sistemi scolastici e formativi avanzati in grado di leggere e scrivere le necessità e le opportunità del tessuto tecnosociale.

Fare comunità è l’aspetto più delicato, perché stiam parlando dell’anima di una collettività, che si traduce poi in spinta motivazionale all’abitare avendo cura del territorio stesso, la nostra casa, il fuoco che la rende viva e intrisa del calore delle relazioni umane. Sopra dicevo delle pratiche di partecipazione, che portano a sviluppare un sentimento di appartenenza: vale per gli individui, vale per le collettività che si riconoscono in valori condivisi, e sanno parlarne per farli emergere affinché diventino patrimonio comune e modo originale per raccontarci a noi stessi e al mondo, in una presa di coscienza forte delle qualità e dei tratti distintivi, nel nostro trovare una nostra voce corale.

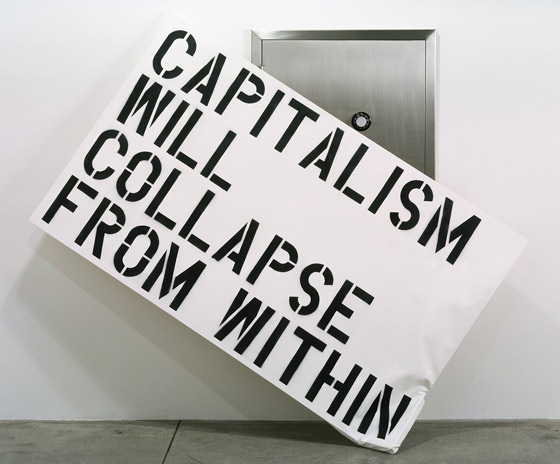

Abbiamo storicamente il capitale economico e il capitale umano – traggo spunto dalle organizzazioni lavorative, ma possiamo traslare il ragionamento alle realtà territoriali – a cui dobbiamo accostare appunto il capitale sociale dato dalle reti relazionali di cui il territorio è intessuto, ovvero come somma olistica delle risorse reali e potenziali sommerse che traggono il loro valore proprio dalla rete di relazioni, dall’impasto unico di impegno civico, fiducia e solidarietà negli individui e nelle collettività, tra i cittadini e tra i cittadini e le istituzioni, tra le istituzioni e le realtà imprenditoriali.

Fare rete, far emergere il valore delle relazioni, orientarsi a obiettivi a lungo termine di Benessere socioeconomico promuovendo trasparenza dei processi, innovazione culturale e consapevolezza dei Luoghi.

Questo può essere raggiunto nella cooperazione e nella collaborazione dei nodi territoriali, nella condivisione della conoscenza, nell’interoperabilità dei sistemi e dei processi di comunicazione – il digitale fa emergere il senso dei Luoghi, in quanto insieme canale e messaggio, rappresentazione mediatica delle collettività e delle prassi territoriali, nelle narrazioni.

Servono grammatiche territoriali, semantica sintassi e morfologia, quindi nuovi significati, nuove importantissime connessioni tra le parti del discorso, serve un nuovo lessico: dobbiamo imparare a leggere e poi a scrivere cose nuove in un modo nuovo, e direi anche piuttosto rapidamente.