È tempo di elezioni politiche, ecco dunque che i candidati si apprestano a illustrare al mondo chi sono, quali sono i valori in cui credono, quindi indicano le cose che non funzionano nell’organizzazione sociale complessiva e particolare, quali dovrebbero essere invece gli obiettivi a cui puntare, come intendono promuovere il cambiamento per migliorare la qualità dell’abitare della collettività sul territorio.

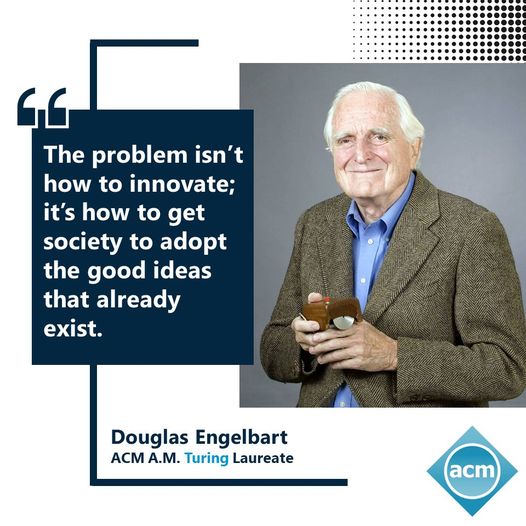

Conseguentemente i candidati alle elezioni in questo momento stanno consciamente o meno allestendo delle campagne di comunicazione, predisponendo strumenti retorici, studiando strategie narrative, individuando contesti interpersonali e massmediatici dove meglio possano brillare i contenuti del proprio discorso politico nonché lo stile del proprio personaggio pubblico.

L’intero discorso politico elettorale è qualcosa-che-sta-per-qualcos’altro, ovvero è un segno, e notoriamente un segno è ciò che può essere usato per mentire, ma qui non è rilevante.

In ogni caso vi sono delle scommesse forti – ripeto: consapevoli o meno – sulle aspettative degli ascoltatori poi votanti, sugli orientamenti politici e financo esistenziali, sulle interpretazioni condivise delle parole degli eventi e delle situazioni locali che poi danno forma al discorso complessivo, alle narrazioni.

È il momento delle storie, quelle che ci servono per dare senso alla realtà, da sempre.

Banalmente, c’è il momento della frattura narrativa – le cose sono cambiate, bisogna agire – dove emerge la necessità di un’azione di cambiamento, c’è un eroe, c’è la narrazione anticipatoria di un lieto fine a cui l’eroe grazie alle sue competenze cognitive e performative può condurci tutti, e salvarci.

Indubbiamente, le promesse dei politici acquistano senso quando possono essere inquadrate e incorniciate (framing) come parte di una narrazione familiare per gli ascoltatori, con cui questi possono identificarsi e relazionarsi, già prevedendo in termini di aspettativa la trama del discorso, delle azioni e degli ostacoli, il significato del successo in termini politici.

Non solo. Queste strategie di framing si riferiscono a un processo di influenza selettiva sulla percezione dei significati veicolati dal discorso politico, quello che attribuiamo a parole o frasi. Stiamo definendo la “confezione” di alcune retoriche in modo da incoraggiare certe interpretazioni e scoraggiarne altre.

Per esempio, i concetti di framing e di agenda setting sono legati: richiamando coerentemente un frame particolare, l’esecutore del framing esercita un efficace controllo sulla discussione e sulla percezione dell’argomento, può ricostruire la cornice del discorso ri-orientando cotesto e contesto comunicativo, e in questo modo stabilire e allestire nel discorso la propria visione, le proprie credenze, la propria persona, le propria parola.

Stabilire una cornice comunicativa investe sul piano dell’enunciazione, del discorso pronunciato, molti aspetti dell’immagine pubblica: dalla scelta del colore della cravatta o del foulard, alla postura della persona, all’uso accorto della prossemica e dello sguardo e del gesticolare nell’eloquio, ai risvolti affettivi e alle metafore, ai rallentamenti o alle accelerazioni o ai cambi nel timbro prosodico, fino alle scelte lessicali e sintattiche, dove ultimamente si prediligono costruzioni discorsive limitate alle famose 6.000 parole di De Mauro che garantiscono una comprensione ampia alla diverse fasce dei popolazione insieme a strutture sintattiche paratattiche, ovvero un periodare di frasi concise e coordinate piuttosto che ipotattiche appesantite da subordinate elaborate ed eleganti ma meno efficaci soprattutto nei contesti della comunicazione massmediatica.

Frasi brevi e ficcanti, dunque, magari colorate di affettività quotidianità ed esperienze personali, che insieme alla struttura narrativa delle “storie da raccontare” garantiscono meglio la ricezione del messaggio e si adeguano maggiormente al sentire e alle schematizzazioni già note degli ascoltatori, per essere depositate più efficacemente nella memoria e prontamente richiamate alla bisogna. Costruisco sul già-noto, e introduco piccole quote di innovazione, altrimenti risulterei incomprensibile.

Persuadere muovendo l’animo, non convincere argomentando in modo logico-razionale, nella migliore tradizione sofista.

La narrazione come forma di esposizione incoraggia la partecipazione, stabilisce un sentimento di appartenenza, contribuisce alla costruzione dell’identità individuale e corale come collettività nazione o popolo, edifica un Noi percepito e vissuto come veicolo di riconoscimento sociale, può essere strategicamente impiegata per rendere possibile lo sviluppo di una comunità o di un attore collettivo.

Le storie, esprimendo concetti astratti o eventi complessi in modo concreto, attuando una dinamica dialettica tra le strutture retorico-discorsive del testo e le strategie interpretative dei lettori-ascoltatori più o meno incanalate dal framing scelto per la loro enunciazione – il testo è una macchina “vuota” che noi arrediamo e vivifichiamo con le nostre proiezioni di senso – saldano un patto profondo e una visione del mondo tra il narratore e l’ascoltatore, garantita dallo stesso principio di cooperazione interpretativa e identificativa dove ognuno di noi in qualche modo modifica e ri-orienta le proprie percezioni e le proprie credenze valoriali per accogliere nuove visioni del mondo.

Le storie hanno una trama. Gli eventi vengono organizzati nella narrazione in implicazioni logiche e temporali, vengono resi significativi nel loro susseguirsi e svilupparsi – altrimenti resterebbero fatti isolati – in direzione di una conclusione anche valutativa, perché tutte le storie hanno una fine e hanno un fine, spesso morale o educativo in senso ampio, capace di elevare le coscienze dei fruitori, di mostrare una realtà futura ma raggiungibile.

In realtà nelle storie delle campagne politiche se il fine è “promettere un mondo migliore” la fine della storia è demandata al momento del voto elettorale, o addirittura al termine del periodo di governo, fatte salve le ulteriori interpretazioni sulla bontà dell’operato dei decisori pubblici. Questo crea un’orizzonte di attese, altra caratteristica intrinseca dell’allestire narrazioni, capace di catturare e tenere avvinto il lettore nello sviluppo degli accadimenti.

Come dicevo, non bisogna porre l’attenzione solamente sul messaggio, anzi. I significati veicolati dalle strategie comunicative acquistano senso solamente in un contesto di enunciazione preciso e concreto, qui e ora.

In quell’incontro pubblico, in quella trasmissione radiotelevisiva, in quell’arredare i canali social del personaggio politico e del suo discorso, nella scelta di quella cravatta o nelle nuove parole necessarie a dipingere la nuova realtà che si vorrebbe instaurare nell’opinione pubblica. Diventa necessaria una migliore comprensione dei contesti in cui la narrazione è attesa, delle convenzioni che regolano quali storie siano considerate comprensibili ed efficaci e le modalità per cui un racconto raggiunge il pubblico con efficacia, appunto con effetto moltiplicato dalla convergenza di fenomeni di mediatizzazione, spettacolarizzazione, e il crescente sentimento antipolitico che si registra nella società italiana. In un simile contesto enunciativo, in relazione all’emergenza di fenomeni come la diminuzione dell’attenzione – overload tipico delle campagne elettorali – e dell’interesse per la politica mediata, le storie sempre più rappresentano la modalità organizzativa regina del discorso politico, al punto da poter permettere il fiorire di professioni legate al marketing politico.

Un ultimo accenno agli aspetti affettivi del linguaggio.

Nelle storie servono esempi e metafore di esperienza personale, per scaldare il discorso e catturare gli ascoltatori dentro un orizzonte immediatamente comprensibile perché empaticamente condiviso e condivisibile, per questo vediamo o auspichiamo di vedere (restando critici sulle manovre manipolatorie del consenso) mani che stringono mani, sguardi rassicuranti o fieramente grintosi, per questo ascoltiamo narrazioni affettive in prima persona da parte del candidato o provenienti da testimonial, sentimenti semioticamente eloquenti come speranza, fiducia, pietà, rassicurazioni ottimistiche, visione ecumenica, determinazione, responsabilità, cura.

Per questo bisogna porre attenzione all’espressione affettiva – spesso contenuta nelle prime frasi del discorso pubblico – in quanto sorta di marca strategica nell’organizzazione delle configurazioni discorsive.

Capite tutti che le cose non possono funzionare così, ma ho fiducia nelle vostre capacità di comprensione e vi prometto solennemente che tutti insieme potremo costruire un mondo migliore, caldo di relazioni umane autentiche e in grado di realizzare concretamente un futuro appagante per tutti.

O anche solo un Facebook migliore, se non proprio un mondo.